Våre kognitive evner – det å tenke, for så å formulere påstander om virkeligheten – er noe av det mest grunnleggende vi gjør som mennesker. Det er det som skiller oss fra dyrene, liker vi å tro.

I løpet av de siste to årene har kunstig intelligens – KI – blitt en del av livet vårt, ledet an av utskjelte og geniforklarte Chat GPT. Både på jobb og i fritiden stiller vi den spørsmål, noen ganger ut av det blå, andre ganger ved å «prompte» den med informasjon, som saksdokumenter eller et ønske om hvilken stil svarene skal komme i.

På kort tid spytter KI-modeller ut mer eller mindre fullgode tekster. Men helt hva som har foregått i «den svarte boksen», og hvorfor vi fikk akkurat det svaret, får vi aldri vite.

Det eneste vi vet, er at denne typen KI er trent opp på enorme mengder tekstbasert informasjon og har lært å skrive og «tenke» ut fra dette enorme datamaterialet.

Basert på denne læringen lager KI-modellen sin forståelse av og sine simulerte påstander om virkeligheten. Den «tenker» og formulerer påstander om virkeligheten – nettopp dette som inntil helt nylig kjennetegnet oss mennesker, ja, som var selve adelsmerket til arten homo sapiens.

Bruken tar av: – Grafikkprosessorene smelter

Hva skjer med oss dersom tenkning og skriving, våre grunnleggende, kognitive ferdigheter, er i ferd med å bli outsourcet til Chat GPT og andre kunstige intelligenser?

– KI-modeller som Chat GPT, Gemini, Copilot og andre er blitt viktige innganger til informasjon og kunnskap. Disse bestemmer hvilket innhold som presenteres for brukere og hvordan det prioriteres. De griper inn i tankemønstrene, forståelseshorisonten hos brukeren. De kan i ytterste konsekvens påvirke vår moral og hvordan vi ser på verden generelt, sier professor Petter Bae Brandtzæg på Institutt for medier og kommunikasjon ved Universitetet i Oslo (UiO).

I artikkelen «Understanding model power in social AI» reflekterer han og medforfatterne Marita Skjuve og Asbjørn Følstad om maktforholdet mellom mennesket og de nye KI-modellene.

Bruker norsk sosiologiklassiker

Artikkelforfatterne ser problemstillingen med en teori om maktforhold utviklet av den nylig avdøde norske sosiologen Stein Bråten for over 50 år siden.

– I 1973 lanserte Bråten sin teori om modellmakt. Teorien peker på at de som kontrollerer eller skaper modeller av virkeligheten, har innflytelse over andres forståelse og atferd. Se på hvordan medier, vitenskap og andre autoritative kilder kan forme folks oppfatning av virkeligheten. Vi bruker teorien til å vise hvordan KI-modeller kan få innflytelse over vår forståelse og oppførsel, forteller Brandtzæg.

KI-modeller som Chat GPT er basert på dialog og har derfor fått navnet «sosial KI». Dialogbegrepet kan riktignok problematiseres. Derfor tar forskerne opp igjen Bråtens idé om «pseudo-dialog».

– Dette viser til en kommunikasjonssituasjon hvor det tilsynelatende foregår en dialog, men der reell gjensidig forståelse eller utveksling av ideer er fraværende, forteller Brandtzæg.

Bråten definerte selv modellmakt som «innflytelse på andre i kraft av en gjennomslagskraftig virkelighetsmodell som de andre tilskriver som kilde for endegyldige svar på spørsmål om et bestemt saksområde, og som utelukker spørsmålshorisonten for alternative perspektiver og virkelighetsdefinisjoner».

I klartekst er det den mektigste parten i et forhold som har mest kunnskap og retoriske ferdigheter og dermed størst modellmakt i Bråtens terminologi, som «vinner» diskusjonene. Forskerne mener dette kan overføres til forholdet mellom menneske og maskin i dagens teknologiske virkelighet.

– Vi tror at Bråtens modell er godt egnet til å beskrive denne relasjonen. Vi lener oss stadig mer til teknologien i alle livets problemstillinger. Interaksjon mellom KI og mennesker kan føre til modellmonopol der KI påvirker menneskelig tro og atferd og kan i verste fall føre til en homogen forståelse av virkeligheten og slik hindre at ulike synspunkter slipper til, sier Brandtzæg.

Brandtzæg, Skjuve og Følstad tror vår stadig større avhengighet av KI kan forandre hvordan mennesker finner, behandler og analyserer informasjon og kunnskap, samt hvordan vi etablerer vår forståelse av verden.

Andre forskere har vist at Chat GPT gir inkonsekvente råd knyttet til moralske spørsmål. Likevel lot brukerne seg i stor grad påvirke til å følge rådene.

– Vi ser ikke selv hvordan vi blir påvirket, og vi inntar villig og vilkårlig standpunktene til den kunstige intelligensen som om de er våre egne. Det fins til og med eksempler på studenter som har gått til Universitetsbiblioteket og spurt om å få låne bøker som ikke finnes, fordi Chat GPT har diktet opp kilder og referanser, forteller Brandtzæg.

Nå skal Open AI trolig lage sin egen «KI-dings»

Vi har KI i lomma

I dag er kunstig intelligens sømløst innlemmet i programmene vi bruker i jobb, på nettsidene vi besøker og på telefonen. Det er stor sannsynlighet for at du har Microsofts Copilot på datamaskina hjemme eller på jobb – og Facebooks morselskap, Meta, lanserte i fjor sin egen virtuelle assistent, Meta AI, i tillegg til modellen fra Google Gemini.

Hvis en norsk tenåring i dag lurer på noe, er sjansen stor for at ungdommen spør Snapchats «My AI», som til enhver tid ligger øverst i samtaleloggen, uansett hvor lenge det er siden den ble tiltalt.

Brandtzæg mener dette kan gjøre oss avhengig av KI-generert informasjon, noe som kan svekke vår egen dømmekraft. Vi blir kognitivt late og tar ofte for gitt at svarene fra KI stemmer.

– På sikt vil dette redusere vår evne til kritisk tenkning og i det store bildet gjøre at færre ulike synspunkter kommer fram i den offentlige samtalen.

Mange blir lett overbevist av de velformulerte svarene til KI-ene. Blant annet har amerikanske forskere vist at folk stoler mer på Chat GPT når de skal finne informasjon om helsespørsmål enn de gjør på søkemotorer som Google.

– Vi ser at folk overvurderer KI, samtidig som de undervurderer selvstendig tenkning. Vi kaller det en overavhengighet av sosiale KI-responser, forteller Brandtzæg.

Grunnleggeren av selskapet DeepMind, Mustafa Suleyman, har beskrevet personlige KI-er mer som et slags vennskap eller kjærlighetsforhold enn en teknologi: «Det kommer virkelig til å alltid være til stede og ved siden av deg, leve med deg – egentlig på laget ditt. Jeg liker å tenke på det som å ha en god trener i hjørnet ditt.»

– Språket som produseres av disse KI-systemene, fremstår som nøytralt, men har potensial til å manipulere sosiale interaksjoner og forsterke sosiale hierarkier.

Sentralt her er at kunstige intelligenser som Chat GPT er språkmodeller, ikke databaser med fakta. De er ikke forpliktet til sannhet, men til sannsynlighetsovervekt.

– Det skjer derfor ofte at språkmodeller «hallusinerer» eller finner opp «fakta» eller detaljer som ikke stemmer overens med virkeligheten.

Sikkerhet: Kun én KI-modell får toppkarakter

Mennesket er den svake part

Stein Bråten brukte sin teori om modellmakt til å undersøke interaksjoner i familier og utdanning, innen vitenskap, utenrikspolitikk og i forretningsnettverk. Han benyttet den også til å sette spørsmålstegn ved verdien av å innføre «demokrati» på arbeidsplasser.

Sosiologen Willy Pedersen peker i en artikkel i tidsskriftet Sosiologen på hvordan en økonom tett på ledelsen i et selskap har mer modellstyrke enn en garderobevakt som er valgt inn i styret som representant for de ansatte. «I de fleste saker som kommer opp på bedriftens styremøter er bedriftens ledelse den modellsterke part. Slik vil dette øke, ikke redusere, bedriftsledelsens kontroll», skriver Pedersen.

– Stein Bråten fant et mønster der enkelte deltakere i samtalen blir marginalisert, og etter hvert tilpasser seg andres perspektiver, tankemønstre og ekspertise, utdyper Brandtzæg.

Det er jo bare å gjette hvem som er økonomen og hvem som er den tillitsvalgte i vårt forhold til kunstig intelligens?

– Vi mener å se at kunstig intelligens er den sterke part i relasjonen til mennesket. Det betyr nødvendigvis at mennesket er den svake, sier Brandtzæg.

Når mer og mer informasjon kommer fra eller blir filtrert gjennom kunstig intelligens, blir mennesker sårbare og manipulerbare.

– Vi er ekstremt påvirkbare i møtet med disse modellene, fordi de nettopp definerer hva som er viktig informasjon og dermed styrer hva vi kan tenke.

Vi kan bli forledet, eller det kan fint hende vi ikke blir det. Men hvorvidt vi blir det, er utenfor vår horisont å oppdage. Det er problematisk i seg selv.

– De kunstige intelligensene kan etter hvert så mye mer enn oss at enhver idé om reell deltakelse vil være tett på illusorisk.

Språkmodeller kan dessuten være ideologisk og politisk orienterte. En fersk studie av ti ledende sosiale KI-er, inkludert ChatGPT-4 og Googles Gemini, fant ut at de gjentok falske fortellinger knyttet til russisk desinformasjon.

– Selv når de ble presentert for enkle, nøytrale spørsmål uten noen eksplisitte signaler for å generere desinformasjon, gjentok disse KI-ene fortsatt falske påstander fra pro-russiske nettverk.

Det er all grunn til å være kritisk, mener Brandtzæg.

– Det spørs om journalister og redaktører som har «kastet seg» over KI, er klar over dette og har et bevisst forhold til alle skjevhetene som kan følge med KI.

Advarer mot big tech-tyranni

Brandtzæg har tidligere advart mot «big tech» sin makt, blant annet i kronikken «Big tech-tyranniet» på bransjenettstedet Medier24.

Begrepet er ikke helt entydig definert. Men eksperter mener vanligvis de fem store amerikanske teknologiselskapene: Alphabet, Amazon, Apple, Meta og Microsoft, også kalt «The Big Five». Andre viser til «The Magnificent Seven», som også tar med prosessorprodusenten Nvidia og bilprodusenten Tesla.

Brandtzægs kronikk den gang kom som svar på at Twitter og Facebook stengte tilgangen for USAs daværende president Donald Trump.

– Man kan si hva man vil om Trump. Men at presidenten i verdens mest toneangivende land ikke skulle komme til orde der milliarder av mennesker samles, er åpenbart problematisk. Det sier litt om hvor mye makt disse selskapene har, når de kan sette munnkurv på verdens mektigste person.

Og dette var altså før de kunstige intelligensene gjorde sin entré på verdensscenen. Nå som big tech tar grep om hvordan vi tenker og formulerer påstander om virkeligheten, kan denne makten mangedobles.

– Nå er det mer subtilt. Kunstig intelligens går inn i tankemønstrene våre, skrivemønstre og derfor handlingsmønstre. Det kan få en enorm påvirkning på hele samfunnet, advarer Brandtzæg.

Artikkelen ble først publisert i Apollon

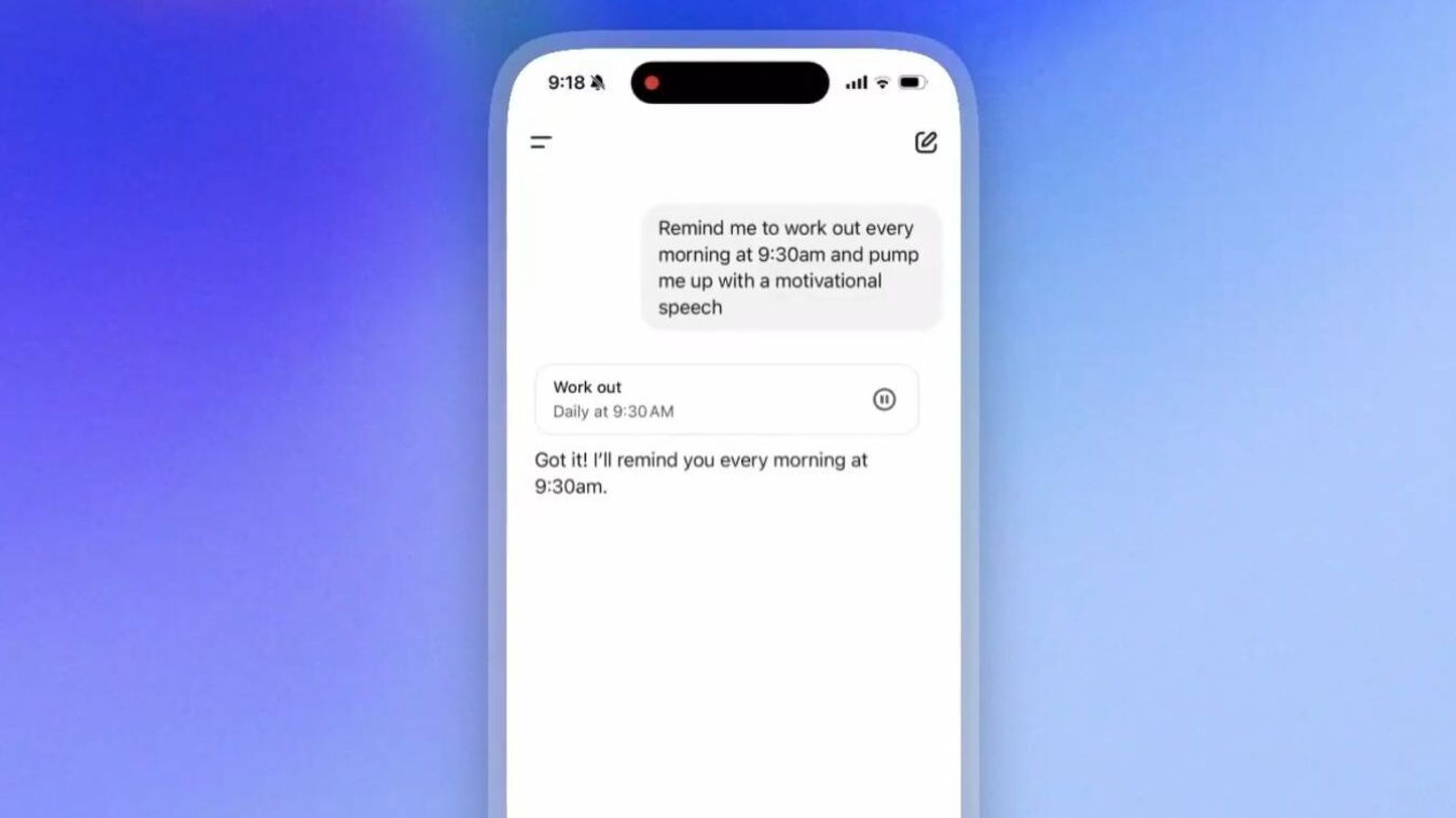

Nå kan du bruke Chat GPT som personlig assistent