Vi har sett det i filmer som Rogue One, Star Wars: The Last Jedi og Blade Runner 2049. Skuespillere som enten er døde eller med årene har blitt mye eldre, gjenoppstår eller vises som en ung utgave av selv. Det ser i blant svært troverdig ut, men så er da også gjort av profesjonelle spesialister på visuelle effekter.

For menigmann har det lenge vært mulig å legge til effekter eller skifte ut ansiktet til folk i bilder. Men å gjøre dette på en troverdig måte i video, med relativt enkelt utstyr, er et betydelig skritt videre.

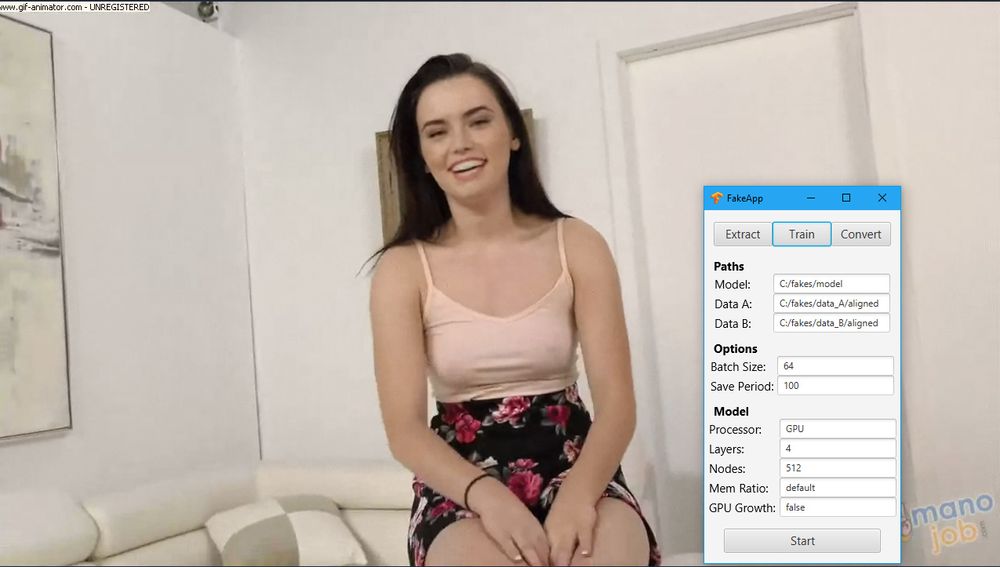

FakeApp

Men nå har også dette ikke bare blitt mulig, men også relativt enkelt for litt avanserte pc-brukere. Og det med en gratisapplikasjon som er lagd av to uavhengige Reddit-brukere, deepfakes og deepfakeapp. Mens førstnevnte opprinnelig lagde et verktøy som gjør selve jobben ved hjelp av nevrale nettverk og en egenutviklet maskinlæringsalgoritme, har sistnevnte lagd en mer brukervennlig variant med grafisk brukergrensesnitt. Dette skriver nettstedet Motherboard.

Appen kalles for FakeApp. Den er Java-basert og gjør det relativt enkelt for ikke-programmerere å lage falske videoer hvor ansiktet til skuespillere eller andre medvirkende skiftes ut med det ansiktet brukeren måtte ønske. Men først må det nevrale nettverket trenes opp.

Slik fungerer det

– Jeg fant en smart måte å utføre ansiktsutskifting på. Med hundrevis av ansiktsbilder kan jeg enkelt generere forvrengte bilder for å trene opp nettverket. Dersom jeg etter det gir nettverket ansiktet til noen andre, vil det tro at det bare er enda et forvrengt bilde og forsøke å få det til å se ut som treningsansiktet, forklarte deepfakes til Motherboard i desember.

Et resultat av dette kan man se i videoen nedenfor, som er fra nevnte Rogue One. Øverst ser man Carrie Fishers ansikt lagt over ansiktet til en stand-in. Nederst har Reddit-brukeren Deepfakes lagd en ny versjon med ansiktet til en skuespiller som ligner på Fisher. Deepfakes skal ha brukt en FakeApp og rundt 20 minutter på å generere den nederste versjonen. Enkelte mener at nederste utgaven er den mest vellykkede.

Men hvor lang tid det i praksis tar å generere slike falske videoer, avhenger av lengden og oppløsningen til videoen, samt maskinvaren FakeApp kjøres på. Det kan nok fort ta noen dager dersom det meste av beregningene må gjøres i en CPU. Men med ett eller flere relativt kraftige grafikkort i pc-en, kan det nok gjøres på noen få timer.

Mest porno

Men det er ikke utskifting av ansiktene til skuespillere i vanlig spillefilm som har ført til at bruken av FakeApp har tatt av. Både deepfakes og mange av de som nå har tatt i bruk applikasjonen har tatt den i bruk for å lage falske pornofilmer, hvor ansiktene til kvinnelige pornoskuespillere har blitt erstattet av ansiktet kjente skuespillere eller artister, inkludert Daisy Ridley, Emma Watson, Scarlett Johanssen og Katy Perry.

Hvor troverdig den falske videoen framstår som, avhenger trolig av en rekke faktorer. Det er blant annet en fordel at det er en viss likhet mellom ansiktene det skal byttes mellom. Videoen som bildet i toppen av saken er hentet fra, er nok blant de mest vellykkede. Videoen er tilgjengelig her og er nokså trygg å se på selv i et kontorlandskap (i alle fall i skrivende stund).

Mange av de andre videoene som ulike brukere har laget, er langt mindre uskyldige. Mange av dem er samlet i en egen kanal («subreddit») på Reddit.

Disse videoene er utvilsomt blitt lagd uten noen av skuespillernes samtykke. Nå som denne virksomheten begynner å bli kjent, kan man ikke annet enn å vente på at søksmålene dukker opp.

Kan bli umulig å oppdage

Til Motherboard sier Alex Champandard, som forsker på kunstig intelligens, at det behøves en tydelig og offentlig debatt om dette fenomenet.

– Alle har behov for å vite hvor enkelt det er å lage falske bilder og videoer, helt til det stadiet, om noen måneder fra nå, hvor vi ikke vil være i stand til å se hva som er falsknerier. Dette har selvfølgelig vært mulig å få til i lang tid, men det ville ha krevd masse ressurser og fagfolk innen visuelle effekter for å gjøre dette. Nå kan det gjøres av en enkelt programmerer med en relativt moderne datamaskin, sier Champandard.

I kjølvannet av en slik debatt, vil forskere ifølge Champandard å utvikle teknologi som oppdager falske videoer, slik at disse kan filtreres ut av nettstedeiere og andre. Han mener at samfunnet er nødt til å forberede seg på å bli i stand til å håndtere dette.

Leste du denne? Gjør maskinlæring tilgjengelig uten å måtte kode: Google lanserer AutoML i skyen