Lanseringen av ChatGPT sendte sjokkbølger gjennom teknologilandskapet, og Meta var blant de som fikk hastverk med å lansere sine egne bidrag. Resultatet var ChatGPT-konkurrenten LLaMa (Large Language Model Meta AI), og nå har denne fått en aldri så liten følgesvenn.

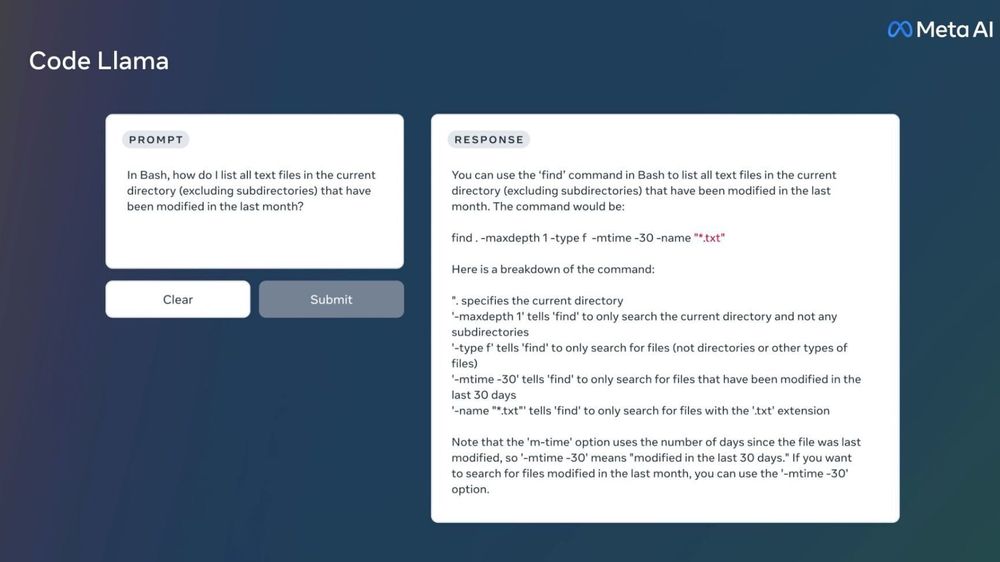

På nettsidene sine har Meta nå dratt sløret av Code Llama – en ny språkmodell spesifikt designet for å skrive kode.

Basert på Llama 2

Code Llama bygger på den andre generasjonen av Llama-modellen, som ble lansert i juni i år, men er trent spesifikt på datasett relatert til kodeoppgaver. Meta selv beskriver modellen som «state of the art» i sitt slag.

Modellen er gratis for kommersiell bruk og til forskning.

Tanken bak Code Llama er altså å forenkle og effektivisere arbeidet for utviklere, men også å senke inngangsterskelen for nybegynnere innen programmering. Den kan generere kode både fra naturlige språkkommandoer og fra kode, og den skal også være velegnet til debugging av kode.

Modellen støtter mange av de mest populære programmeringsspråkene som er i bruk i dag, deriblant Python, C++, Java, PHP, Typescript (Javascript), C#, Bash og flere.

Meta skal slippe tre varianter av Code Llama. Disse opererer med 7, 13 og 34 milliarder parametere og er trent på 500 milliarder kodeenheter. Selskapet opplyser videre at de to minste variantene med 7 og 13 milliarder parametere også er trent på såkalte FIM-egenskaper (fill-in-the-middle), som setter dem i stand til å injisere kode i eksisterende kode.

Kjent komiker saksøker OpenAI og Meta

Skal ha høyere ytelse enn andre modeller

Den største utgaven på 34 milliarder parametere vil naturlig nok servere bedre resultater og by på mer omfattende assistanse, mens de to mindre variantene leverer raskere resultater og er bedre egnet til mindre krevende oppgaver, ifølge Meta.

I ytelsestester sier Meta at Code Llama lå på nivå med ChatGPT når det gjelder kodeferdigheter, og høyere enn tilsvarende, kodeorienterte språkmodeller på markedet. Selskapet sier at sikkerhet også har vært en prioritet, og i forsøk på å få Code Llama til å skrive ondsinnet kode, skal modellen ha produsert sikrere responser enn GPT 3.5-modellen til OpenAI.

I tillegg til de ovennevnte utgavene har Meta også sluppet to finjusterte versjoner av den nye modellen – Code Llama - Python og Code Llama - Instruct. Førstnevnte utgave spesialiserer seg på koding i det populære Python-programmeringsspråket og er trent opp på 100 milliarder kodeenheter i dette språket.

Code Llama - Instruct er på sin side finjustert til å bedre forstå og tolke naturlige språkkommandoer fra brukerne, og til å generere bedre svar i naturlig språk.

Mer informasjon om Code Llama kan man finne i Metas gjennomgang, og de tekniske findetaljene er nedfelt i et omfattende forskningsdokument.

Slik gjør ChatGPT forskerne mer effektive