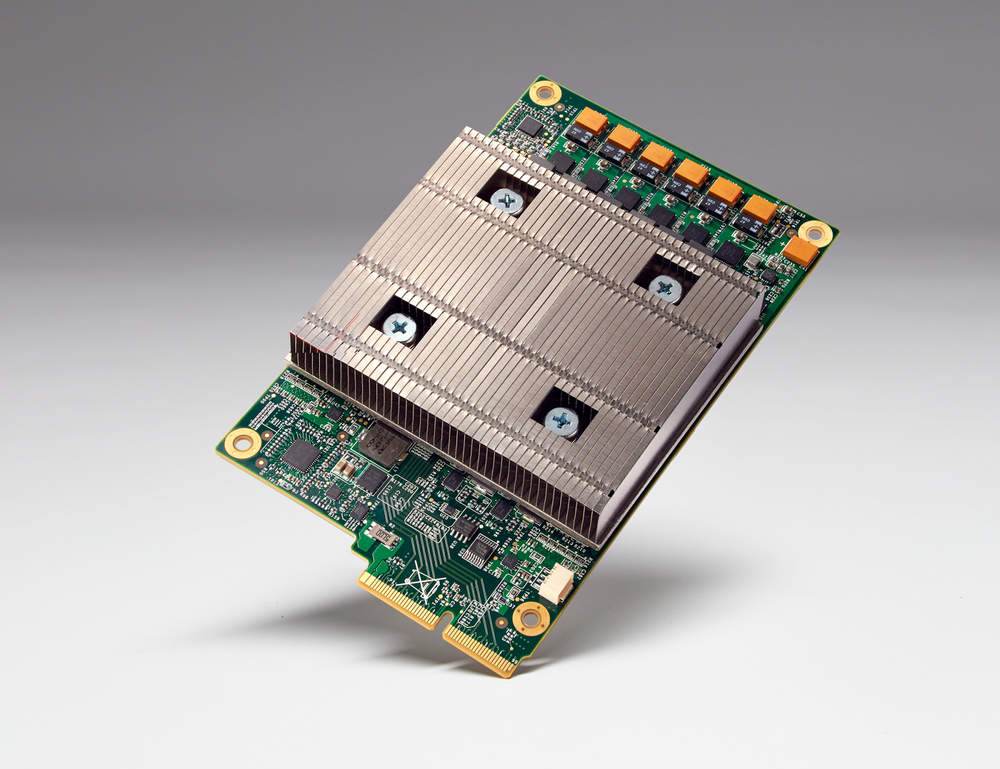

Google fortalte denne uken at selskapet har utviklet en egen spesialprosessor, Tensor Processing Unit (TPU), som selskapet for rundt et år siden tok i bruk i forbindelse med selskapets satsning på maskinlæring.

Brikken, en skreddersydd ASIC, er spesielt laget for nettopp slike oppgaver og skal kunne gjøre dem med omtrent ti ganger bedre energieffektivitet enn det til nå har vært mulig.

Utviklingen av brikken har skjedd i det skjulte over flere år. Som navnet antyder, er det særlig maskinlæringsprogramvaren TensorFlow TPU-en er ment for.

- Mer om TensorFlow: Google gjør maskinlæring tilgjengelig for alle

Forenklet arkitektur

Noe av det som gjør brikken så effektiv, er at den ifølge Google er bygget for å være mer tolerant overfor beregninger med redusert presisjon. Dette gjør at den krever færre transistorer per operasjon, noe som igjen gjør det mulig å utføre flere operasjoner per sekund.

I Googles serverrack er TPU-ene montert på et relativt lite kretskort som passer inn i en vanlig harddiskbrønn.

- Leste du denne? Googles nye assistent skal delta i samtalen

I omfattende bruk

TPU-ene benyttes i dag i forbindelse med en rekke av Googles produkter, inkludert blant annet RankBrain som skal bidra til bedre søkeresultater, og for å forbedre kartene, navigasjonen og Street View-funksjonaliteten i Google Maps.

Også AlphaGo-systemet som spilte og vant Go-kamper mot verdensmesteren Lee Sedol, var TPU-basert.

- Les mer om AlphaGo og TPU-er hos Tek.no.