Google avholdt nylig sitt direktesendte Search On-arrangement, og der ble en del nyheter om selskapets kjerneprodukt – nemlig søkemotoren – kunngjort.

Det viser seg at Google har store planer for videreutvikling av sitt trauste søkeverktøy, og det neste steget i evolusjonen er å gjøre visuelle søk enda mer avanserte ved hjelp av kunstig intelligens.

Lar deg stille spørsmål om bilder

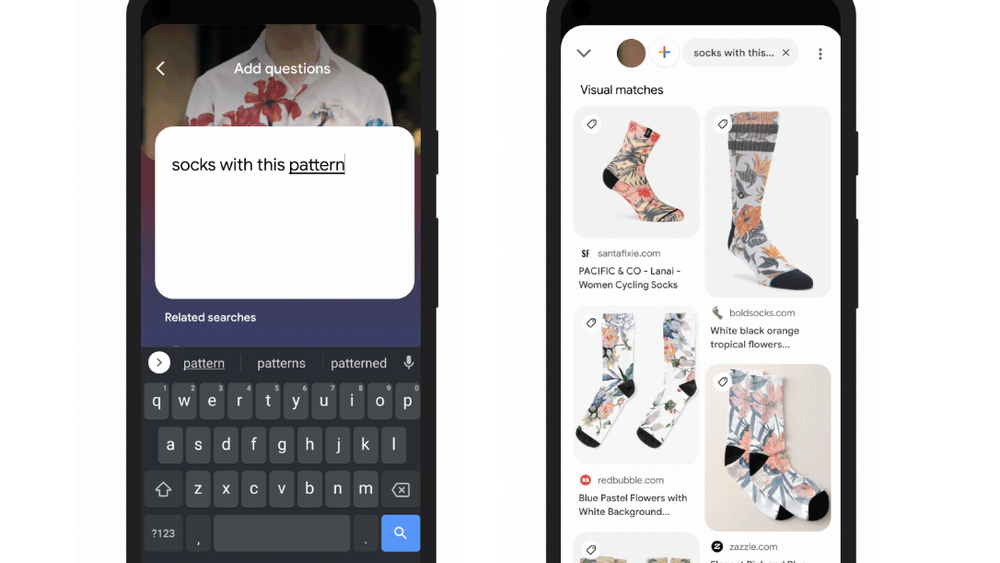

I løpet av de kommende månedene skal selskapet gjøre det mulig å foreta søk ved å stille spørsmål om det som befinner seg på bilder.

Dersom man for eksempel tar et bilde av et klesplagg med et bestemt mønster man har sansen for, kan man søke etter andre typer klesplagg med det samme mønsteret. På den måten trenger man ikke å beskrive det man ser med kun ord, en ofte krevende oppgave, som Google påpeker.

Visuelle søk er som kjent allerede mulig ved hjelp av Google sitt Lens-verktøy, som gjør det mulig å foreta Google-søk basert på bilder man tar med mobilkameraet. Det nye her er imidlertid muligheten til å faktisk stille spørsmål om det som vises på bildet.

Den nye funksjonaliteten integreres i Lens-funksjonen og aktiveres ved å trykke på Lens-ikonet mens det aktuelle bildet vises på skjermen.

Et annet eksempel på bruksområde er reparasjoner. I stedet for å søke seg frem til de aktuelle delene som må fikses, kan man bruke funksjonen til å simpelthen ta bilde av den ødelagte delen og spørre Google om hvordan den kan fikses – som da tar brukeren rett til relevante DIY-videoer eller lignende.

«Multitask Unified Model»

Den nye teknologien er basert på noe Google kaller Multitask Unified Model (MUM), som selskapet presenterte på I/O-konferansen tidligere i år. MUM beskrives som en milepæl i arbeidet med å bruke kunstig intelligens til å forstå informasjon på en langt mer avansert måte enn tidligere, og til å utføre mer kompliserte oppgaver med Googles søketeknologi.

MUM-teknologien skal også bygges direkte inn i søkemotoren i form av en ny funksjon Google kaller «ting å vite» – en slags meny som gir brukerne ulike typer tilleggsinformasjon om det man søker på, basert på hvordan brukere utforsker temaene. Dermed er det altså meningen at man skal få kjapp tilgang til den mest relevante og nyttige informasjonen først.

Denne funksjonaliteten skal også komme i løpet av de nærmeste månedene, uten at noe konkret tidspunkt foreligger.

Ikke minst vil MUM også få betydning for videoer. Ved hjelp av teknologien vil Google heretter kunne identifisere temaer som er relatert til det som vises i videoene, for å gi brukeren relevante lenker. Ifølge Google vil MUM til og med kunne servere brukeren relaterte temaer som ikke nødvendigvis nevnes eksplisitt i videoene, basert på dypere forståelse av innholdet.

Mer informasjon om Google-nyhetene finner du på selskapets offisielle blogg.

Google-app skal avsløre hudsykdom – men bare i Europa