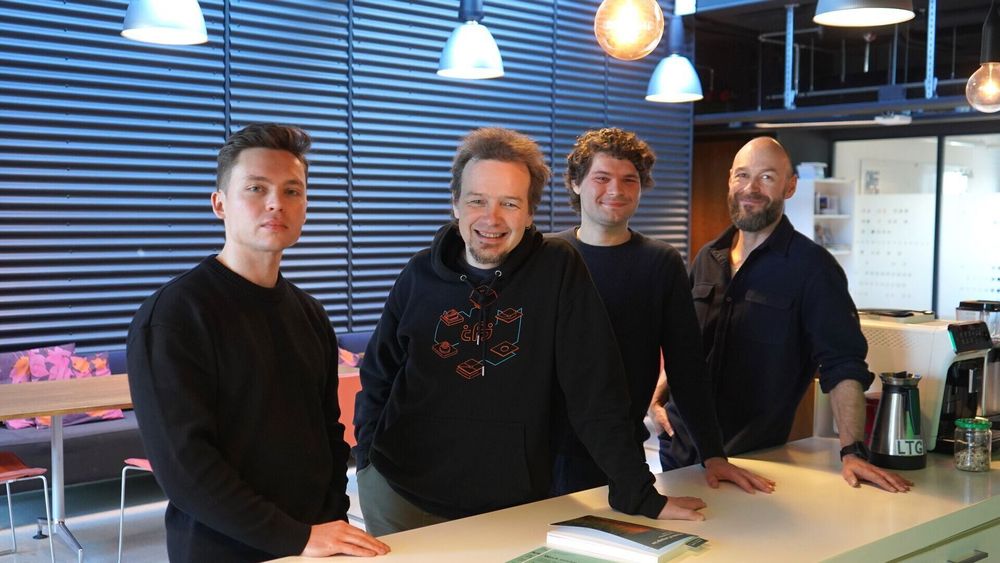

– Det er mange problemer knyttet til tekgigantenes språkmodeller. De fremstår som sorte bokser for verden utenfor. Vi trenger norske alternativer, sier professor Erik Velldal.

Før jul skjedde det noe helt avgjørende for å få fortgang i det norske motsvaret til Chat GPT som utvikles av forskningsgruppen for språkteknologi ved Universitetet i Oslo.

De fikk tildelt regnetid på Europas kraftigste datamaskin, LUMI i Finland. Dermed kunne de trene store språkmodeller på norske data. I løpet av et par uker ble nok data prosessert til at forskerne kunne lansere tre norske språkmodeller.

– Trening av store språkmodeller krever veldig mye regnekapasitet fra det vi kaller GPU-er, mikroprosessorer. Dersom man dobler antallet GPU-er involvert, vil det grovt sagt gå dobbelt så fort å gjennomføre treningen. Fordelen med LUMI er at det er svært mange GPU-er til rådighet, over 10.000, sier sier spesialrådgiver Hans A. Eide i Sigma2, et non-profit-selskap med ansvar for den nasjonale e-infrastrukturen for forskning.

Flere treningsrunder

– Nasjonalbiblioteket og Universitetet i Oslo har tilgjengeliggjort flere norske språkmodeller tidligere, men dette er de største vi har laget så langt, og de er trent på over 30 milliarder ord, forklarer Velldal.

Alle modellene har rundt syv milliarder parametre, noe forskerne vurderer som optimalt i forhold til mengden norske treningsdata som er tilgjengelig.

– En språkmodell blir dårlig om den trenes på for lite materiale i forhold til størrelsen. Det handler om å finne rett balanse, sier Velldal.

Et triks som har vist seg effektivt dersom man har nok prosessorkraft, er å trene på de samme dataene i flere runder. Modellene UiO har trent på LUMI, har blitt matet med de samme treningsdataene seks ganger, forklarer Velldal.

Teknologisk selvråderett

Språkteknologigruppen tilknyttet UiO mener det er viktig å ha norske motsvar til Open AIs Chat GPT og Googles Lamda. Norsk utgjør bare én promille av språkmengden Chat GPT er trent på. Det er heller ikke fullt ut kunngjort hvilke data modellen er trent på. Det er problematisk på flere måter, mener Velldal.

– Microsoft og Open AI lar norske brukere få tilgang til modellen i et nettgrensesnitt. Modellen bak er lukket.

– I mange sammenhenger kan det også være problematisk å sende fra seg data til en kommersiell tredjepart. Dersom man for eksempel jobber med sensitive helsedata, er det viktig å kunne kontrollere hvor og hvordan dataene behandles. Da er det essensielt å ha tilgang på åpne og frie modeller som utviklere kan kjøre på sine egen maskiner.

Flere store norske statlige aktører har likevel kastet seg på og kjøpt tilgang til Open AIs Chat GPT.

– Det er viktig å sørge for at åpne norsk-utviklede modeller blir tilgjengelige som et alternativ, kanskje spesielt for offentlig sektor, påpeker Velldal.

Osloskolen er blant de siste som har kunngjort at de vil bruke den amerikanske tjenesten. Det på tross av at det er flere uavklarte spørsmål rundt rettigheter og opphavsbeskyttet materiale i modellene. UiOs forskere jobber også med Nasjonalbiblioteket i et prosjekt der de skal sammenligne språkmodeller som er utviklet på fritt tilgjengelig materiale og opphavsbeskyttet materiale. På sikt vil dette kanskje kunne gi retningslinjer for en fremtidig kompensasjonsordning for bruk av opphavsrettslig materiale i språkmodeller.

Open AIs nye modell: Knuste andre i ekstremt krevende test

Fremhever stereoptyper

Det er flere viktige grunner til at vi trenger norske språkmodeller, ifølge førsteamanuensis Andrey Kutuzov ved UiO. Chat GPT er i veldig liten grad tilpasset kunnskaps- og verdigrunnlaget i Norge, påpeker han.

– Tekgigantenes språkmodeller er i all vesentlighet trent på engelsk og amerikansk språk. De gjenspeiler dermed også et amerikansk verdisett og kultur. Et eksempel kan være at de amerikanske språkmodellene samsvarer i større grad med kjønnsmessig fordeling av yrker som er mer stereotypisk enn tilfellet er i Norge, sier Kutuzov.

I tillegg ser man ofte at engelske uttrykksmåter smitter over i den norske ordlyden.

– En norsk språkmodell vil i mye større grad reflektere samfunnet slik vi kjenner det i Norge, sier Kutuzov.

Må trenes på å løse oppgaver

De norske språkmodellene er lansert og er allerede lastet ned av flere tusen brukere. Modellene er i første omgang myntet på forskere og utviklere. Kutuzov forklarer at de norske versjonene ikke er lansert i nettgrensesnitt som er enkelt å bruke for mannen i gata.

Han innrømmer at de fremdeles er langt unna å kunne tilby de mulighetene som de kommersielle språkmodellene gir. Modellene er i større grad trent for å være generelle basismodeller.

– En språkmodell trenes i flere steg. Disse norske modellene har fått grunntreningen, som betyr at de klarer å forutsi hvilket ord som er det neste i en tekst.

For at de norske modellene skal komme opp på samme nivå som Chat GPT eller lignende modeller, må de ha mer såkalt instruksjonstrening. Dermed vil de i større grad bli i stand til å løse ulike oppgaver. Dette arbeidet er allerede i gang ved UiO, og nye, oppdaterte versjoner av språkmodellene vil lanseres fortløpende.

Selv om kappløpet med de amerikanske modellene fremstår som tøft, påpeker forskerne at norske språkmodeller må utvikles videre.

– Det er et viktig prinsipp at vi lager modeller som er fri for restriksjoner. Vi må ha slike modeller som er basert på åpent tilgjengelige ressurser og som er transparente for forskningsmiljøer og næringsliv. Store språkmodeller vil i økende grad fungere som grunnleggende infrastruktur for å løse ulike oppgaver innen forskning, næringsliv, forvaltning og samfunnet ellers, sier Velldal.

Artikkelen ble først publisert på Titan.uio.no

Open AIs nyeste KI-modell er kraftig forbedret på ett område