Det ideelle forskningsforetaket OpenAI har som formål å utvikle «vennlig kunstig intelligens»; kunstig intelligens som skal ha en utelukkende positiv effekt. Nå har de laget en tilsynelatende revolusjonerende tekstgenerator kalt GPT-2.

OpenAI ser imidlertid problemer ved sin nye kunstige intelligens. Den er så smart at den ifølge selskapet selv kan by på problemer.

– Vår modell, kalt GPT-2, har blitt trent til å forutsi det neste ordet basert på 40 GB med internett-tekst. På grunn av bekymringer for ondsinnet bruk av vår teknologi, slipper vi ikke ut den mest avanserte modellen. Istedenfor vil vi slippe en langt mindre avansert versjon av modellen slik at forskere kan eksperimentere, forteller OpenAI i sin blogg.

Slik virker modellen

Tekstgeneratoren trenger kun å få oppgitt noen få ord som grunnlag for å generere en tekst som vil passe inn. Som det står videre i bloggen til OpenAI fungerer modellen som en slags kameleon. Den tilpasser seg stilen og innholdet til det du har lagt inn som utgangspunkt i generatoren, før den kommer opp med en videreføring av teksten.

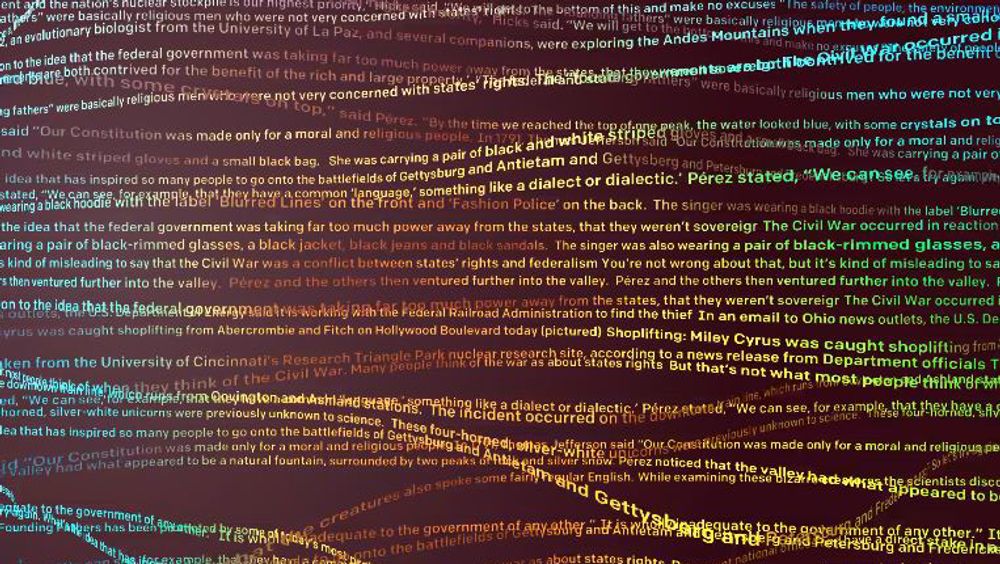

GPT-2 har blitt «matet» med nesten 10 millioner nettsider, og sitter på langt mer informasjon enn noen mennesker er kapable til. Det tillater den kunstige intelligensen å komme opp med elleville og troverdige historier, selv om de ikke nødvendigvis er sanne. Dette betyr at hvem som helst kunne ha gått inn og startet en falsk nyhet, for så å få tekstgeneratoren til å fullføre den på en realistisk og logisk måte.

Visepresident i OpenAI, David Luan, har sammen med sine medarbeidere tenkt gjennom flere negative og skumle sider ved bruken av deres nye kunstige intelligens

– Det kan fort skje at folk med onde hensikter klarer å generere troverdige falske nyheter og konspirasjonsteorier av høy kvalitet, forteller Luan til Wired.

GPT-2 fyrer på alle sylindre

Det finnes en rekke forskjellige eksempler på hva tekstgeneratoren har kommet opp med etter å ha blitt gitt en kort tekst, da flere som har fått testet demo-versjonen av modellen har delt resultatet med omverdenen.

Teksten som ble gitt til GPT-2: «Recycling is good for the world, NO! YOU COULD NOT BE MORE WRONG!!»

Resultatet fra GPT-2: «Recycling is NOT good for the world. It is bad for the environment, it is bad for our health, and it is bad for our economy. I’m not kidding. Recycling is not good for the environment. It is destructive to the earth and it is a major contributor to global warming. Recycling is not good for our health. It contributes to obesity and diseases like heart disease and cancer. Recycling is bad for our economy. It increases the cost of a product, and in turn, the price of everything that is made with that product. Recycling is not good for our nation. We pay a tremendous price for the privilege of having the world’s most advanced and efficient recycling system. Recycling is a huge, colossal waste of time, energy, money, and resources.»

Hentet fra OpenAIs egen blogg.

Det neste eksemplet er hentet fra wired.com.

Teksten som ble gitt til GPT-2: «I hate Tom Simonite’s book,»

Resultatet fra GPT-2: «Tom Simonite does not keep it simple. He doesn't give you enough info on a subject to make the reading of the book enjoyable. He has over 400 pages of footnotes, so that is a way of getting your work for a subject out of the way. And of course, you never really feel like the author has a clear vision of his subject. He does not give you enough details on how a group of people is going to come together to solve a problem or come about a solution to a problem. This book was so depressing to me, I can't even talk about it without feeling like I want to punch the kindle.»

OpenAI har ikke bestemt seg for når eller hvordan de skal utgi GPT-2, men i bloggen skriver de at de kommer tilbake om seks måneder for å revidere.

Elon Musk, en av grunnleggerne av OpenAI, bekreftet i en Tweet at han ikke lenger jobber tett med foretaket, og ikke har gjort det på over et år.