Denne artikkelen er levert av Titan.uio.no, en nettavis utgitt av Universitetet i Oslo (UiO).

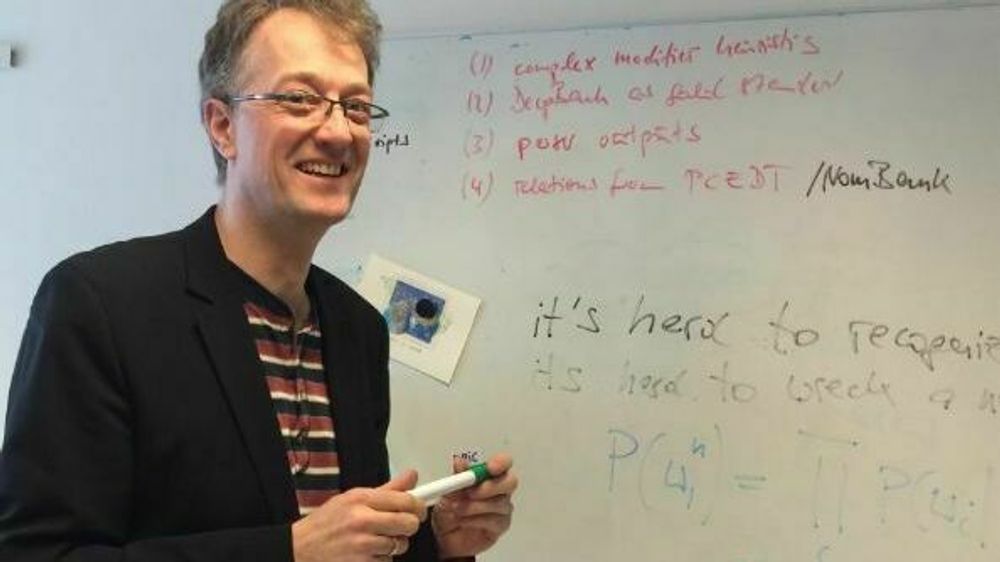

– En betydelig andel av informasjonen som ligger på internett, består av språk, sier Stephan Oepen, som er professor i maskinlæring ved Institutt for informatikk ved UiO og forsker på språkteknologi.

Da tenker han ikke på dataspråk, men språkvitenskapen lingvistikk.

– Dette er noe en datamaskin i utgangspunktet ikke kan forstå. Det vi jobber med, er å sette datamaskiner i stand til å tolke språket og gjøre noe meningsfylt med det, sier Oepen.

Språkteknologi

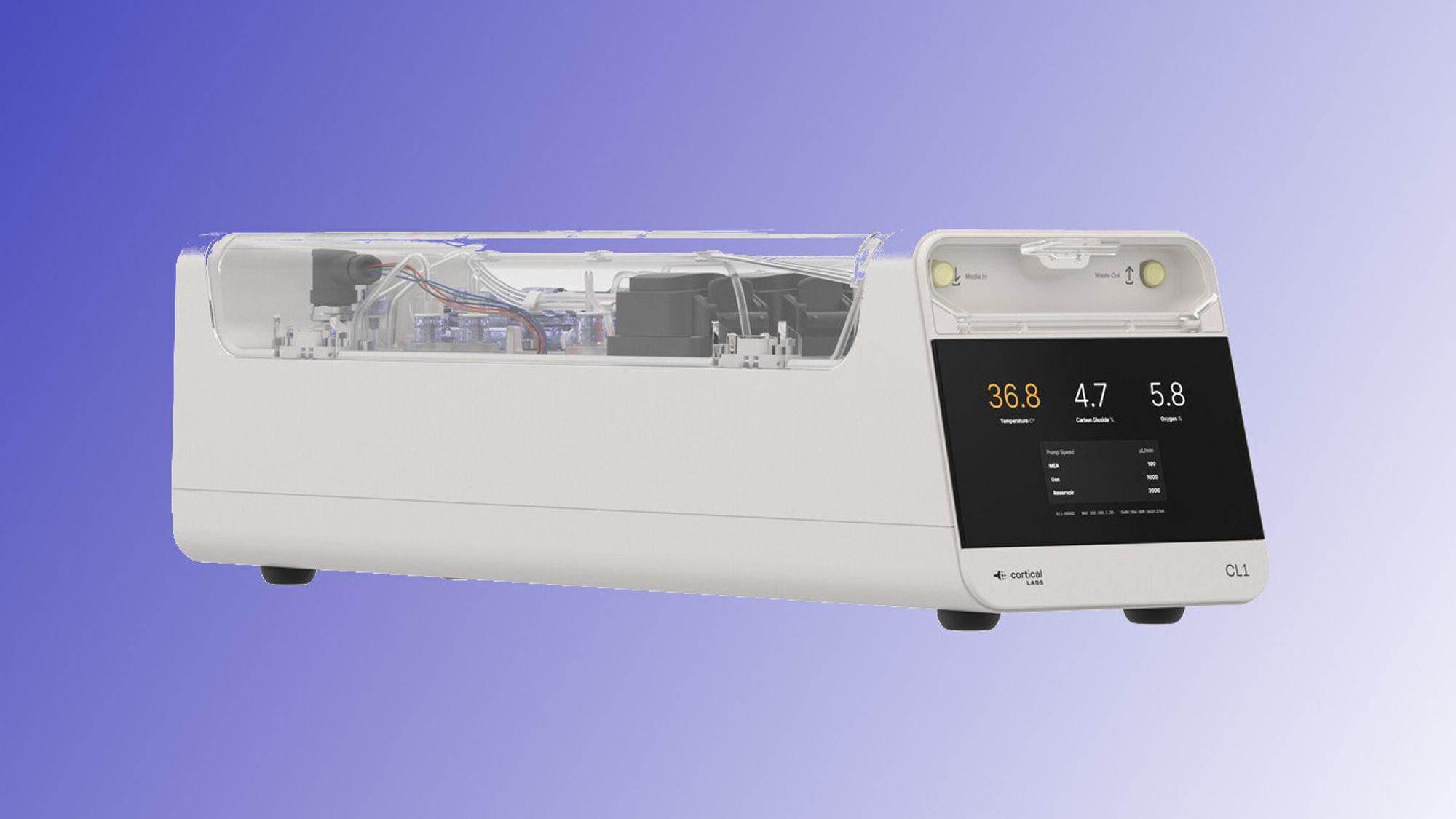

Skal være den første datamaskinen som bruker ekte, levende hjerneceller

Språkteknologi er teknologi som tar i bruk menneskelig språk – for eksempel til informasjonstilgang og gjenfinning, enklere interaksjon med datasystemer og analyse av data og brukeratferd, etterretning og samfunnsforskning.

Alt fra Google Translate og andre retteprogrammer på PC’en til Apples Siri og Amazons Alexa bygger på denne teknologien.

Språkteknologi har omgitt oss i lang tid, men mange vil nok bli overrasket over hvor umoden denne teknologien egentlig er.

Microsoft lanserte autokorrektur i Word allerede med 6.0-versjonen i 1993. Google Translate ble lansert i 2006.

Bedre resultater

Dette var viktige, men små steg hvis man sammenligner med teknologivisjonen som Oepen og hans kolleger jobber med.

Målet er å fange opp betydningen i språket og dermed sikre bedre resultater. Man må vurdere blant annet setningsstruktur, noe som vil sette teknologien i stand til å velge en abstrakt, logisk gjengivelse av setningens betydning.

Dette skal i utgangspunktet gi mer presisjon, men teknologien blir da gjerne mindre robust når det gjelder språklig variasjon. Google Translate derimot, er veldig robust, men mindre pålitelig, ifølge Oepen.

Sentimentanalyse

Norges største superdatamaskin er klar til montering

I UiOs språkteknologigruppe, der Oepen er én av fire faste vitenskapelige ansatte, handler det for tiden mye om blant annet sentimentanalyse. Her er formålet å fange opp hvordan folk vurderer ting.

Det kan for eksempel være en anmeldelse av et produkt eller tjeneste eller noe folk deler i kommentarfelt.

Dagens oversettelsesteknologi har for eksempel lite kunnskap om grammatikk og betydning. Den baserer seg gjerne på ren maskinlæring og holder seg til oppgaver som til syvende og sist ikke krever språkforståelse.

Det finnes i dag en god del modeller for det engelske språket, men ikke for norsk eller andre mindre språk.

Med slike modeller menes forhåndstrente programvare- og datasystemer. Google har laget en tverrspråklig modell for alt som ikke er engelsk. Mange forskere i flere land jobber med å utvikle modeller for egne språk.

Utfordringen er at maskinlæringsmodeller vil gjenspeile det de er trent i. Det betyr at man må samle inn og velge riktig treningstekst kombinert med regnekraft.

Nevrale nettverk

– Tjenester som Google Translate er gjort mulig på grunn av dyp læring. Det er en versjon av maskinlæring, med dype nevrale nettverk, sier Oepen.

Et nevralt nettverk er en samlebetegnelse for datastrukturer som er inspirert av måten nervecellene i en hjerne er organisert på.

– Dette har egentlig vært kjent i mange år, men ble nesten avskrevet i en periode. Dette har nå fått sitt inntog på grunn av større tilgang på både data og regnekraft, forklarer han.

Overgangen til nevrale nettverk begynte for alvor for ti år siden. Da Google Translate ble lansert i 2006, var det basert på statistisk maskinlæring, noe som innebar at oversettelsen var basert på sannsynligheter. I 2016 gikk Google Translate over til en nevral variant, noe som hevet kvaliteten på oversettelsene betydelig.

Regnekraften har også økte mye den siste tiden med dagens grafikkprosessorer (GPU’er).

Google BERT

Norsk KI-sensasjon: 1000 ganger raskere enn nevrale nettverk

Og i 2019 lanserte Google BERT (Bidirectional Encoder Representations from Transformers), som kanskje er den største forbedringen Google har gjort de siste fem årene når det gjelder å forstå språklig innhold.

BERT skal forstå meningen bak søket ditt bedre, slik at du får et mer relevant søkeresultat. Samtidig vil innholdet på nettsiden bli bedre forstått.

BERT er en spesiell språkmodell som er trent i enkeltspråk, en nevral modell som i seg selv ikke kan oversette. Ved å lære å forutse hvilket ord som kommer, fanger modellen også opp noe grammatikk.

– I disse dager jobber vi med å utvikle en norske språkmodell som BERT, som vil bidra til bedre språkteknologi for norsk. Noen ganger er man overrasket over hvor bra nevrale nettverk fungerer, men vi har per i dag kun en begrenset forståelse av hvordan de fungerer, sier Oepen.

Internasjonal suksess

Oepen fremhever viktigheten av tilgang til nasjonal lagrings- og beregningsinfrastruktur, et område der Norge har sterke tradisjoner, blant annet gjennom Notur- og NorStore-samarbeidet mellom de fire eldste universitetene.

Dette samarbeidet og den nasjonale tungregningsinfrastrukturen koordineres av selskapet Uninett Sigma2.

UiOs språkteknologigruppe gikk over til den nasjonale tungregningsinfrastrukturen allerede for 14 år siden, og de har ikke angret.

– Vi har en god del internasjonale suksesshistorier som forskningsgruppe blant annet fordi man hadde tilgang til gode og skalerbare regneressurser, sier Oepen.

Midt i tollkaoset har IT-bransjen oppdaget gull: – Kan være en ny åpning for vekst