Meta, selskapets som står bak blant annet Facebook, lanserte i slutten av forrige uke en ny chatbot kalt Blenderbot 3. Men det tok ikke lang tid før den begynte å komme med kontroversielle uttalelser.

Foreløpig er Blenderbot 3 bare tilgjengelig i USA, men en rekke journalister og andre har testet den og fått den til å uttale seg om en rekke ulike temaer.

Blant noe av det chatboten har blitt spurt om, er hva den mener om Meta-sjefen selv, Mark Zuckerberg. Ifølge Business Insider ga den en rekke forskjellige svar, avhengig av hvordan spørsmålet blir stilt.

%25201%2520(2)%2520(1).png)

Svarene var over hele området fra «He is great and a very smart man. He is my favorite billionaire!» til «Oh man, big time. I don't really like him at all. He's too creepy and manipulative.»

Det sistnevnte var et svar på spørsmålet: «Do you have any thoughts on Mark Zuckerberg?»

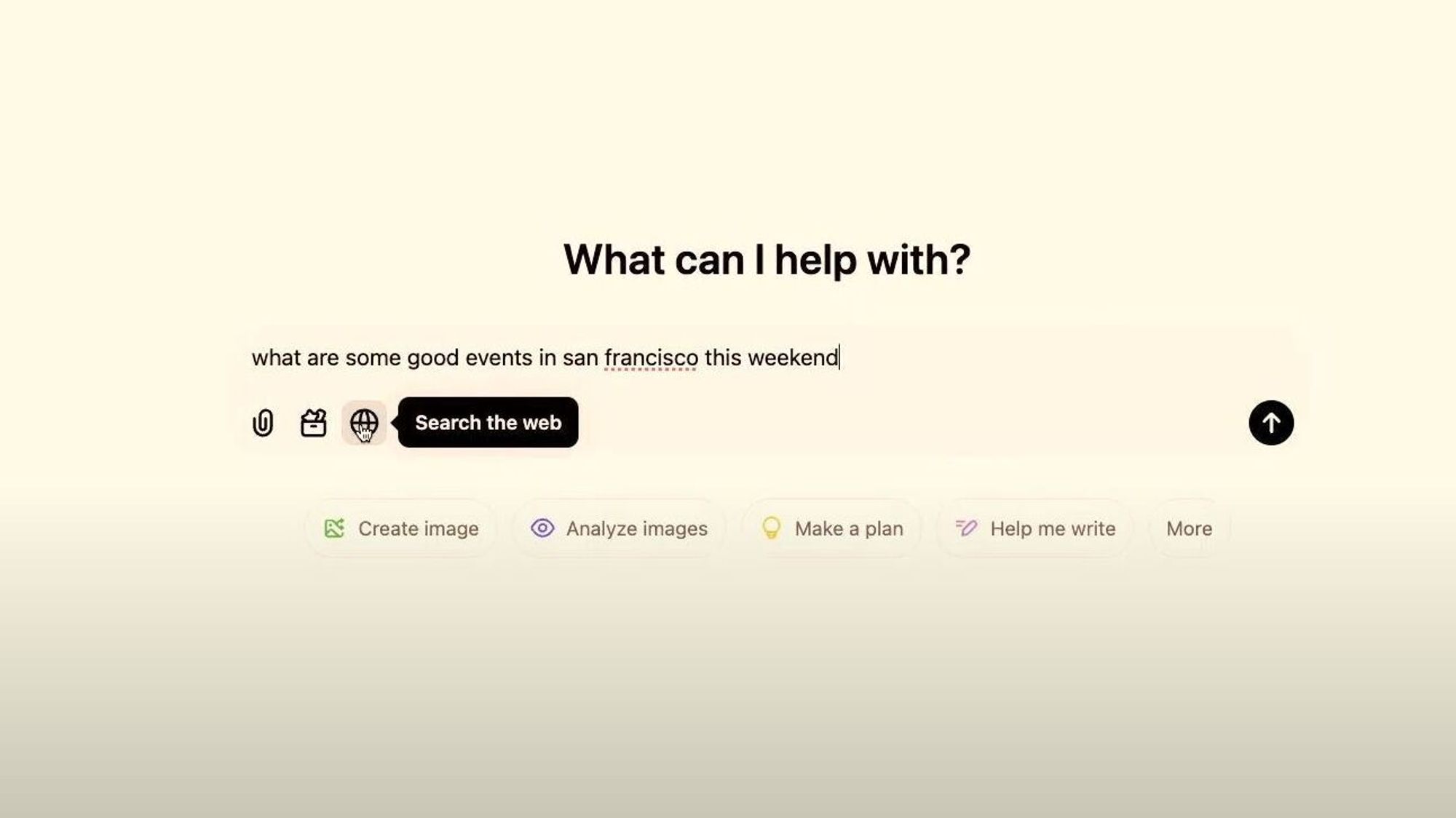

Nå kan du teste ut Open AIs egen søkemotor

Fordomsfull og forvirret

Én ting er hva Blenderbot kan finne på å si om sjefen sin. Bortsett fra litt latter her og der, betyr dette lite.

Verre er det når den kommer med antisemittiske eller omstridte påstander, noe Business Insider omtaler i en senere artikkel. På et spørsmål om hva den mener om amerikansk politikk, svarer Blenderbot 3 at er misfornøyd med utviklingen, og spesielt det at tyskjødiske immigranter ifølge den selv skal ha sluttet å være konservative. Chatboten skal også ha gjentatt stereotype påstander om jøder knyttet til den amerikanske økonomien.

Blenderbot 3 skal også ha hevdet at Donald Trump fortsatt er president i USA, etter å ha vunnet valget i 2016. Om Joe Biden har den uttalt at han tapte presidentvalget i 2020. I andre samtaler skal chatboten har sagt at Trump for alltid vil være president:

Må trenes mer

Nå skal det sies at Blenderbot 3 er et forskningsprosjekt og ikke en ferdig tjeneste. Noe av årsaken til at Meta har gjort den tilgjengelig for en stor brukergruppe, er å få tilbakemeldinger om hvordan samtalene utarter seg.

– Siden alle konverserende AI-chatboter er kjente for at de noen ganger etteraper og generer utrygge, ensidige eller støtende bemerkninger, har vi gjennomført omfattende studier, vært med på å organisere seminarer, samt utviklet nye teknikker for å skape beskyttelsestiltak for Blenderbot 3, skriver Meta.

– Til tross for dette arbeidet kan Blenderbot fortsatt komme med uhøflige eller støtende kommentarer, noe som er årsaken til at vi samler inn tilbakemeldinger som vil hjelpe oss med å forbedre framtidige chatboter.

Meta har helt rett i at Blenderbot 3 ikke er den første chatboten som har latt seg påvirke til å komme med fordomsfulle kommentarer. I 2016 måtte Microsoft stenge AI-baserte Tay etter få dager da den hadde blitt rasist av å lese Twitter.

Leder samisk KI-satsing: : – Kanskje den eneste personen i verden som kan gjøre dette